智算多多

智算多多

用户其实不必非得选择性能配置单一、与windows操作习惯迥异、综合性价比不太高还经常缺货的Mac mini,还有更多针对不同需求的高性价比选择,比如香橙派。

香橙派OrangePi拥有从百元左右的超低功耗开发板到万元级训推一体机的完整产品线。为了帮助不同需求的用户找到最适合自己的养虾平台,我们深入梳理了香橙派四大系列产品,并针对C端(开发者爱好者)和B端(企业学校)的不同场景,给出了代表产品推荐。

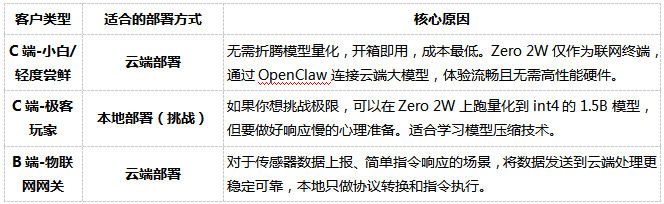

当然,选对硬件只是第一步。OpenClaw的AI模型运行在哪里(本地、云端还是混合),同样决定了最终的使用体验、成本和安全边界。还将分析不同部署方式的利弊,并针对不同用户的不同需求,从上述四大系列中选择匹配度最高的产品,明确给出部署建议:什么情况该地,什么情况该上云端。

1 代表产品:Orange Pi Zero 2W

2 芯片平台:全志 H618 (四核Cortex-A53)

3 NPU算力:无独立NPU,依赖CPU推理

4 内存选项:1GB/1.5GB/2GB/4GB LPDDR4

enClaw的起跑线。Zero 2W以百元左右的超低价格提供运行轻量级龙虾模型的可能性。

Zero 2W没有独立NPU,完全依赖CPU运行AI模型,推理速度较慢。如果强行本地运行稍大的模型,响应时间可能长达几十秒或者无法加载,体验不佳。因此,最合理的方案是:本地运行OpenClaw框架,AI推理调用云端API。

1 代表产品:OrangePi 5 Plus

2 芯片平台:瑞芯微 RK3588(八核64位)

3 NPU算力:内置 6 TOPS AI加速器

4 内存选项:最高支持32GB LPDDR44x

5 推荐模型规模:3B~7B参数(流畅运行主流小参数模型)

6 推荐理由:

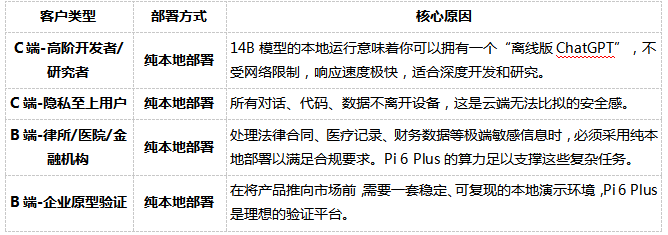

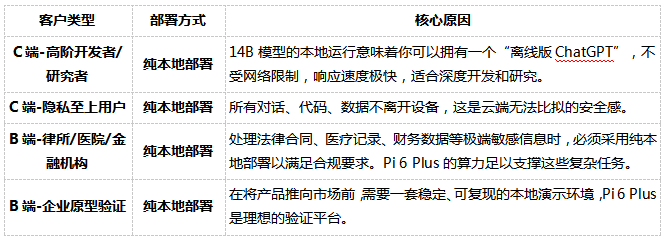

这是OpenClaw部署的“黄金甜点”。RK3588系列是香橙派生态最完善、性价比最高的产品之一。

7 适用人群:

为什么?Pi 5 Plus拥有6TOPS NPU和最高32GB内存,完全有能力本地流畅运行7B参数的量化模型。NPU推理速度比CPU快5倍以上。同时支持通过OpenClaw灵活切换后端:日常任务用本地模型,复杂推理临时切到云端。

1 代表产品:OrangePi6Plus

2 芯片平台:此芯 CD8180 (12 核 CPU)

3 NPU算力:45 TOPS

4 内存选项:最高64GB LPDDR5 (128-bit位宽)

5 存储扩展:双PCIe 4.0 NVMe SSD插槽

6 推荐模型规模:7B~14B参数(运行复杂推理任务)

7 推荐理由:这是香橙派家族中的性能猛兽,专门为端侧大模型革命设计。

8 适用人群:

为什么?45TOPS的综合AI算力和64GB LPDDR5内存,让Pi 6 Plus成为香橙派家族中专门为端侧大模型设计的性能猛兽。OpenClaw已在该平台上完成全面适配和优化,可实现快速部署。既然硬件足够强大,完全没有必要依赖云端。

1 代表产品:OrangePi AI Studio/Studio Pro

2 芯片平台:华为昇腾310P(16核ARM)

4 内存选项:Pro版最高192GB LPDDR4X

5 推荐模型规模:14B~32B+参数(支持模型微调与推理)

6 推荐理由:

这是OpenClaw部署的旗舰机产品,定位为专业的推训一体机。

为什么?AI Studio Pro的定位是完全摆脱云端依赖的专业级推训一体机。352TOPS算力不仅支持大模型推理,还能进行模型微调和优化。它本身就是为那些无法将数据送出的高安全需求场景设计的。